(Italian translation of the post follows here – La traduzione in italiano è disponibile qui)

Big Data was one of the most talked buzzwords of 2011 and despite there’s no lack of interesting trends for 2012 – eHealth, Collaborative Consumption, IT consumerization, Post TV era… – I think that the focus on Big Data will it’s not fade so quickly.

To quote a clear and concise definition of the market, appropriately given by James Kobielus from Forrester

“Big data means extremely scalable analytics: It means analysing petabytes of structured and unstructured data at high velocity. That’s what everybody’s talking about.”

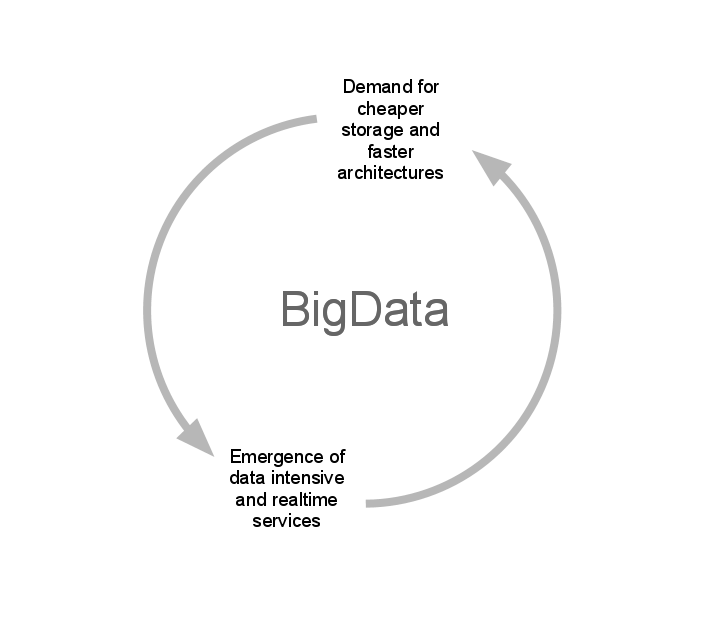

Big Data, finds its actual origin in – and feeds itself on – a virtuous circle: on one hand the rising conceptual need to handle – in real time – of huge amounts of information, to avoid losing any data (if it’s gone it’s lost), to profile users and preferences and to historicize any online activity; on the other hand a parallel pursuit – and push at the same time – of technology towards this scenario, that is becoming more and more impressive.

Technology has been able to adapt to this trend at many different layers.

From the hardware point of view falling storage costs ideally now allow to store all the music ever produced with a few thousand if not hundred dollars; on the other hand dozens of software solutions – still in the maturation phase – aim to overcome classic Relational Database Management Systems allowing faster access to amounts of data – tens if not hundreds times larger than in the past (look to Apache Hadoop, or to the dozens of products born from the NoSQL paradigm).

Despite predictions for this market are very encouraging, and the number of players involved is becoming huge – now including giants such as Oracle or HP (especially after the acquisition of Autonomy) – there’s still not a very clear logic, about what is the real potential of the BigData “revolution” in terms of innovation, generation of new scenarios and potential impact on our daily lives.

When it comes to the potential market size, Gartner estimates a Business Intelligence and Analytics market growing – especially thanks to Bigdata – up to 10.5 billion $ in 2012 while Deloitte, in its “Technology, Media & Telecommunications Predictions 2012” says that, by the end of 2012, 90% of Fortune 500 Companies will feature at least a BigData pilot project and revenues generated from BigData alone will grow from 100 million $ in 2011 to about 1/1.5 billion $ in 2012.

Not bad considering that it is a fledgling industry and that the real data revolution, that of the connected objects and smart cities, is still to come.

Beyond the purely economic dimension, there’s another size that’s key to consider when we talk about BigData: the smallest bit of personal life information.

It is clear that recent years of information explosion was generated by the turn towards user-centric networks that we recently lived. User-generated content and social and personal communications were undoubtedly the first and most powerful lever of this explosion: while waiting for the wave of data that we expect to get from the world of sensors, machines and objects (the Internet of Things), the overwhelming data flow coming from sharing portals, social networks, and real time messaging systems, forced us to rethink architectures, protocols and business models.

It was all this hat led to things like AWS or Azure, created to meet the need to compute, manage, store, historicize, and organize the ocean of interactions flooding over the web every day.

By the way, now that we have technologies, a lack of methodologies to extract knowledge and meaning from data, keeps intuitions hidden inside them. Our ability to analyze, therefore, is likely to represent the real bottleneck to prevent a revolution waiting to be liberated.

The question, however, is this: can a linear, strictly functional and algorithmic approach – ultimately based on machines – inherited from decades of traditional systems, enable us to operate on this sea of seemingly unstructured data hiding greatly valuable information?

The answer is no, especially if the insights that we are searching for are the ones that should allow us to real improve our quality of life as humans.

Among the first to have understood that this task requires radical innovations, it was undoubtedly Stephen Wolfram. Wolfram – who not coincidentally has a great history as a scientist that spent his life creating new means of interpretation (look at his studies about cellular automata and his novel “A New Kind of Science” and “How To Become A Real Estate Agent“) as well as operational tools (Mathematica) – guessed that facing complex data and information, and transforming it into usable, actionable, knowledge requires a human intervention, and a curation activity, for data preparation and presentation.

Not surprisingly, after a few years during which few actually undestood the scope of Wolfram Alpha, the product had a positive market positioning and now represents also one of the knowledge sources of Siri, the revolutionary intelligent personal assistant ended up talking with you on the iPhone 4S.

However, the curation model chosen by Wolfram – to carry out this knowledge extraction work in the close, thanks to a team of curators and offer it as a service on the market – is just one of the imaginable ways and is more than reasonable to expect this approach to be rapidly juxtaposed by solutions of social and collaborative curation platoforms as well as traditional algorithmic approaches.

But, how to get to this? Once again, I think we’ll get it through the dimension of “personal.”

Those of you that heard about Quantified Self know that this represents the ability to extract – through devices, applications, or even with spontaneously data collection actions – valuable data from our day by day life: thanks to the correlation of these data with information about our daily welness feelings, habits or even our ability to achieve goals we could later understand how to adapt ourselves for a better life enjoyment.

To date the vast majority of these Quantified Self tools have a single, personal, dimension but probably, the great hidden potential of this approach lies in the socialization and anonymisation of data going from measuring myself to measuring society as made up of thousands of individuals: aggregating data, we could reach to collective insights, as a result of collective, shared analysis.

To achieve this, however, we still lack of many things such as clear personal data publication models – which, like the creative commons made for cultural production, could provide means to safely share our information and merge it into the collective analysis systems – or new tools for analyzing complexity.

Maybe, the time has come to reevaluate the great insights of the, recently disappeared, immense Benoit Mandelbrot which helped us to see nature through chaos by the shape of fractals. His work could be used to create new and in-depth analysis tools that might help us to solve some of the great challenges we face right now and help us to see hidden patterns in the ocean of information.

Image Credits: The IBM Curiosity Shop

You should follow me on twitter here.

And, if you liked the post, please tweet this!

Italian translation follows.

Quanto è piccolo Big Data?

Bigdata è stata una delle buzzword più discusse del 2011 e malgrado in questo 2012 i trend interessanti non manchino – ehealth, collaborative consumption, IT Consumerization, Post TV era … – credo che l’attenzione su questo tema non sarà destinata a scemare in tempi brevi.

Per citare una chiara e stringata definizione del mercato, opportunamente data da James Kobielus di Forrester Research:

“Big data means extremely scalable analytics: It means analysing petabytes of structured and unstructured data at high velocity. That’s what everybody’s talking about.”

Più praticamente Il tema bigdata, trova la sua origine e si autoalimenta in un circolo virtuoso: da una parte l’ esigenza sempre più stringente di gestire – possibilmente in real time – quantità enormi di informazioni, di non tralasciare nulla (ogni dato lasciato andare è perduto) per profilare gli utenti e le loro preferenze e storicizzare ogni attività online, dall’altra una parallela rincorsa – e spinta nello stesso tempo – della tecnologia a questo scenario che sta producendo risultati veramente impressionante.

La tecnologia ha infatti saputo adattarsi al tema su diversi livelli: da un punto di vista hardware i costi di storage in picchiata fanno si che oggi, al costo irrisorio di qualche centinaio di euro, sarebbe virtualmente possibile immagazzinare tutta la musica mai prodotta nella storia; da un punto di vista software sono nate decine di soluzioni, ancora in via di maturazione, atte a superare l’approccio classico dei data base relazionali prospettando modalità di gestione dati più adatte a consentire un accesso veloce a quantità di dati decine se non centinaia di volte più grandi rispetto al passato (chi non conosce ormai Apache Hadoop o le decine di prodotti nati nell’ambito NoSql).

Malgrado le stime relative a questo mercato siano molto incoraggianti e malgrado i player coinvolti stiano diventando sempre di più – includendo ora giganti quali Oracle o HP (in particolare dopo l’acquisizione di Autonomy), non c’è ancora grande chiarezza, da un punto di vista logico, a proposito di quello che è il reale potenziale che la “rivoluzione” big data promette in termine di innovazione e generazione di nuovi scenari, use cases e potenzialità in grado di avere impatto sulle nostre vite.

Ma quale reale “dimensione” c’è dietro la parola “BigData”?

Se parliamo di dimensione in termini di mercato potenziale siamo davanti a numeri a dir poco importanti: parliamo infatti di un mercato della Business Intelligence e Analytics che Gartner stima, in crescita anche e soprattutto grazie agli investimenti nell’area BigData, a 10.5 miliardi di $ nel 2012 mentre Deloitte, nel suo Technology, Media & Telecommunications predictions 2012, predice che entro la fine del 2012 il 90% delle Fortune500 avranno progetti in ambito BigData e le revenue generate dal mercato passeranno dai 100M$ del 2011 a circa 1,5B$. Non male se consideriamo che si tratta di una industria appena nata e se riflettiamo sul fatto che la vera rivoluzione dei dati, quella degli oggetti connessi e delle smart cities, è ancora alle porte.

Al di là della dimensione puramente economica. c’è tuttavia un’altra dimensione importante da valutare quando parliamo di big data: quella del più piccolo pezzetto della nostra vita personale.

È evidente come l’esplosione informativa di questi anni sia stata figlia della svolta in direzione user-centric che la rete ha vissuto. I contenuti user-generated e la comunicazione personale e sociale sono stati senza dubbio la prima e più potente leva di questa esplosione: ancor prima dell’ondata di dati che ci aspettiamo arrivare dal mondo dei sensori, delle macchine e degli oggetti (internet of things) sono stati i portali di sharing, i Social network, i sistemi di messaggistica in real time che ci hanno costretto a ripensare architetture, protocolli e modelli di business, che hanno spinto i grandi di internet a creare infrastrutture elastiche come AWS o Azure per rispondere alla chiara esigenza di memorizzare, storicizzare, organizzare quella montagna di interazioni che inondano il web giorno dopo giorno.

Ma ora che abbiamo la tecnologia, quello che salta agli occhi è una forte mancanza di metodologie per estrarre dai dati la conoscenza, il significato, l’intuizione che in essi è nascosta. La capacità di analisi dunque rischia di essere il vero collo di bottiglia a impedire una nuova rivoluzione che aspetta di essere liberata.

La domanda da porsi però è la segente: può un approccio lineare, strettamente funzionale e algoritmico – in definitiva machine based – ereditato da decenni di sistemi tradizionali, consentirci di operare su un mare di dati apparentemente destrutturati che nascondono informazioni di enorme valore? la risposta è no, specie se le intuizioni che vi cerchiamo sono quelle che devono permetterci di migliorare la nostra qualità di vita.

Tra i primi ad aver interpretato questa necessita di innovazione è stato, indubbiamente, Stephen Wolfram. Wolfram, che non a caso ha una storia di scienziato spesa a creare strumenti sia interpretativi (i su studi sugli automi cellulari e il suo “A new kind of science”) che operativi (Mathematica) ha intuito forse prima di tutti, come di fronte a dati e informazioni complesse, trasformare questi in conoscenza fruibile da tutti necessitasse di un intervento umano, una attività di “curation”, preparazione e presentazione.

Non a caso, dopo qualche anno in cui in pochi capivano effettivamente la portata di Wolfram Alpha, questo sta trovando il suo poszionamento sul mercato e rappresenta, per esempio, una delle sorgenti della conoscenza di Siri, il rivoluzionario personal assistant intelligente e parlante finito sull’iPhone 4S.

Tuttavia, il modello di curation scelto da Wolfram – quello di effettuare questo lavoro di sistemazione e estrazione di conoscenza dai dati al chiuso di una “redazione” di curatori e offrirlo come servizio sul mercato – è solo uno dei modi immaginabili ed è più che lecito aspettarsi che a questo approccio si affianchino rapidamente, oltre al classico approccio machine based, soluzioni di Info/data curation che sfruttino la dimensione sociale dell’individuo e un approccio collaborativo.

Ma come giungere a questo? Ancora una volta, credo che ci arriveremo attraverso la dimensione “personale”.

Chi di voi ha sentito parlare di quantified self sa che questo tema riguarda la capacità di estrarre – tramite device, applicazioni, o anche spontaneamente – preziosi dati dalla propria esistenza giorno dopo giorno per trarne in seguito, a valle di analisi e valutazioni, importanti insegnamenti: grazie alla correlazione degli stessi dati con informazioni riguardanti il nostro benessere, la nostra quotidianità o la nostra capacità di raggiungere obiettivi riusciremo a capire come adattare noi stessi per vivere al meglio.

Ad oggi la stragrande maggioranza di questi servizi di Quantified Self ha una dimensione singola e personale ma probabilmente, la grande potenzialità nascosta di questo approccio, sta nella socializzazione e anonimizzazione dei dati e quindi nel passaggio dalla misurazione di una singola persona alla misurazione di una società fatta di migliaia si singoli individui che, aggregando i dati, potranno giungere a intuizioni collettive, frutto di analisi collettive.

Per arrivare a questo ci manca però ancora molto, a partire da modelli di publicazione di dati personali – che, come i creative commons hanno fatto per la produzione culturale, ci forniscano gli strumenti per condividere le nostre informazioni e farle confluire nei sistemi di analisi collettiva – a nuovi strumenti di analisi della complessità.

È forse giunto il tempo, ad esempio, che le grandi intuizioni del recentemente scomparso e immenso Benoit Mandelbrot, che aveva intravisto nei frattali l’ombra del caos e della natura, umana e non, vengano approfondite e utilizzate per scoprire nuovi strumenti di analisi, strumenti che forse saranno in grado di risolvere alcune delle grandi sfide che ci troviamo di fronte e di aiutarci a vedere disegni nascosti nell’oceano delle informazioni.

Pingback: How Small is BigData? | meedabyte « Jose Murilo’s Weblog

Pingback: Web Round Up October 2012 | Somatosphere